Psicoacústica

La psicoacústica es una rama de la psicofísica que estudia la relación existente entre las características físicas de un estímulo sonoro, y la respuesta de carácter psicológico que el mismo provoca en un sujeto.

Es una disciplina esencialmente empírica. Sus conclusiones se obtienen a partir del análisis estadístico de los resultados de experimentos que buscan medir la respuesta subjetiva de sujetos a estímulos de propiedades físicas cuantificadas.

Antecedentes

[editar]Escuchar no es meramente un fenómeno mecánico de la propagación de onda, sino es también un acontecimiento sensorial y perceptivo; es decir cuando una persona escucha algún sonido, este llega al oído como una onda acústica mecánica que viaja a través del aire, pero dentro del oído humano se transforma en impulsos eléctricos neurológicos. Estos pulsos nerviosos después viajan al cerebro donde son percibidos. Por lo tanto en muchos problemas de acústica, por ejemplo el procesamiento de audio, es desventajoso considerar los mecanismos del ambiente solamente. Hay que considerar por tanto también el hecho de que el oído y el cerebro están implicados en la experiencia de escucha de una persona.

El oído interno, por ejemplo procesa significativamente la señal para convertir las formas de ondas en estímulos nerviosos, así que ciertas diferencias de forma de onda pueden llegar a ser imperceptibles.[1] Las técnicas de compresión de datos, como un MP3, hacen uso de este método.[2] Además, el oído tiene una respuesta no lineal a diferentes intensidades de sonido; esta respuesta no lineal se llama sonoridad. Las redes telefónicas y los sistemas reductores de ruido en audio usan este sistema, comprimiendo muestras de los datos antes de la transmisión y luego expandiéndolas para el aparato de lectura.[3] Otro efecto de la respuesta no lineal del oído es que las frecuencias de estos sonidos son más bajas y producen un sonido fantasma o intermodulacion producto de una distorsión.[4]

Límites de percepción

[editar]

El oído humano normalmente escucha sonidos entre 20 Hz (0.02 kHz) y 20,000 Hz (20 kHz). El límite máximo tiende a decrecer con la edad; la mayoría de los adultos no pueden escuchar más de 16 kHz. La frecuencia más baja que han identificado en un tono musical es de 12 Hz en condiciones ideales de laboratorio.[5] Los tonos que están entre 4 y 16 Hz pueden ser percibidos físicamente por el sentido del tacto del cuerpo.

La resolución de frecuencia del oído es 3.6 Hz dentro de la octava de 1000–2000 Hz. Es decir, cambios en el tono más grande que 3.6 Hz pueden ser percibidos en entornos clínicos.[5] Sin embargo, las diferencias de tono más pequeñas pueden ser percibidas por otros medios. Por ejemplo, la interferencia de dos tonos puede ser escuchada a veces como una variación repetitiva en el volumen del tono. Este efecto de variación de fase sobre el sonido se conoce como interferencia.

La escala de semitonos usada en la notación musical occidental no es una escala de frecuencia lineal sino logarítmica. Otras escalas se han obtenido directamente a partir de experimentos sobre la percepción del oído humano, tales como la escala Escala Mel y Escala Bark (éstas se utilizan en el estudio de la percepción, pero generalmente no en la composición musical), y estas son aproximadamente logarítmicas en la frecuencia en el extremo de la frecuencia más alta, pero casi lineal en el extremo de la frecuencia más baja.

El rango de intensidad de los sonidos audibles es amplio. Los tímpanos del oído humano son sensibles a las variaciones en la presión del sonido, y pueden detectar los cambios de presión tan pequeños como algunos micropascales a más de 1 bar. Por esta razón, el nivel de presión del sonido se mide también de manera logarítmica, con todas las presiones referenciadas a 20 µPa (or 1.97385×10−10 atm). Por tanto, el límite inferior de audibilidad se define como 0 dB, pero el límite superior no está tan claramente definido. El límite superior es más una cuestión del límite donde el oído será dañado físicamente o con el potencial de causar daño auditivo permanente.

Una exploración más rigurosa de los límites inferiores de audibilidad determina que el umbral mínimo en el que un sonido no se escucha es dependiente de la frecuencia. Al medir esta intensidad mínima para probar tonos de diversas frecuencias, un umbral absoluto depende de la frecuencia absoluta de audición (ATH)curva que se puede derivar. Por lo general, el oído muestra un pico de sensibilidad (es decir, su ATH más bajo) entre 1-5 kHz, aunque los cambios de umbral con la edad, con oídos más desgastados muestra disminución de la sensibilidad por encima de los 2 kHz.[6]

El ATH es el nivel más bajo de las ecualizaciones sonoras. La ecualización sonora indica el nivel de presión sonora (dB SPL), en el rango de frecuencias audibles, que son percibidos como de igual sonoridad. La ecualización sonora se midió por primera vez por Fletcher y Munson en los Laboratorios Bell en 1933 en el uso de tonos puros reproducidos a través de auriculares, y los datos que recogen son llamados curvas de Fletcher-Munson. Debido a que el volumen subjetivo era difícil de medir, las curvas de Fletcher-Munson fueron cuestionadas por muchos otros temas.

Robinson y Dadson mejoraron el proceso en 1956 para obtener un nuevo conjunto de curvas de igual sonoridad de una fuente de sonido frontal medido en una Cámara anecoica. Las curvas de Robinson-Dadson fueron normalizadas en ISO 226 en 1986. En 2003, ISO 226 se revisó como ecualización sonora a partir de datos recogidos de 12 estudios internacionales.

Localización del sonido

[editar]La localización del sonido es el proceso de determinar la ubicación de una fuente de sonido. El cerebro utiliza sutiles diferencias en la intensidad, el tono y el tiempo entre las dos orejas para permitirnos localizar fuentes de sonido.[7] La localización puede ser descrita en términos de posición en tres dimensiones: El azimut o ángulo horizontal, el cenit o el ángulo vertical, y la distancia (para los sonidos estáticos) o la velocidad (para los sonidos en movimiento).[8] Los seres humanos y la mayoría de los animales cuadrúpedos son expertos en detectar la dirección en el horizontal, pero no tanto en la vertical debido a que los oídos están colocados simétricamente. Algunas especies de búhos tienen sus oídos colocados asimétricamente, y pueden detectar el sonido en los tres planos, una adaptación para cazar pequeños mamíferos en la oscuridad.[9]

Efectos de Enmascaramiento

[editar]

En algunas situaciones un sonido de forma claramente audible, se puede enmascarar con otro sonido. Por ejemplo, la conversación en una parada de autobús puede ser completamente imposible si un camión está sonando con mayor fuerza. Este fenómeno se denomina enmascaramiento. Un sonido más tranquilo se enmascara si se hace inaudible en presencia de un sonido más fuerte.

Software

[editar]

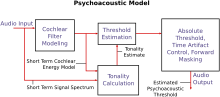

El modelo psicoacústico permite que nosotros podamos eliminar la pérdida de datos en la compresión de señal de alta calidad de escucha, además mediante la descripción de las partes de una señal de audio digital dada se pueden eliminar (o comprimir demasiado) con seguridad —es decir, sin pérdidas significativas en la calidad (real) percibida del sonido—.

Esto explica como un fuerte aplauso de las manos puede parecer extremadamente alto en una biblioteca tranquila, pero apenas se nota después de que un coche transita en una calle urbana concurrida. Esto proporciona un gran beneficio a la relación global de la compresión, y el análisis psicoacústico conduce rutinariamente a los archivos de música comprimidos que son 1/10 a 1/12 el tamaño de los archivos originales de alta calidad, pero con pérdida de calidad visiblemente menos proporcional. Tal compresión es una característica de casi todos los formatos de compresión de audio con pérdida modernos. Algunos de estos formatos incluyen Dolby Digital (AC-3), MP3, Ogg Vorbis, AAC, WMA, MPEG-1 Layer II (utilizado para la radiodifusión sonora digital en varios países) y ATRAC, la compresión usada en el MiniDisc y algunos modelos de Walkman.

La psicoacústica se basa en gran medida de la Anatomía humana, especialmente en las limitaciones del oído para percibir el sonido como se describe anteriormente. En resumen, estas limitaciones son:

- Límite superior de frecuencia

- Umbral de audición

- Umbral de dolor: Llamamos umbral de dolor a la potencia o intensidad sonora a partir de la cual el sonido produce en el oído sensación de dolor. Su valor medio se sitúa en torno a los 110-130 dB o 20 pascales.

- Enmascaramiento temporal

- Enmascaramiento frecuencial

Teniendo en cuenta que el oído no estará en capacidad perceptiva máxima cuando se trata de estas limitaciones, un algoritmo de compresión puede asignar una prioridad menor a los sonidos fuera del alcance del oído humano. Al desplazar cuidadosamente los bits de distancia de los componentes sin importancia y hacia los más importantes, el algoritmo asegura que los sonidos más probables de percibir son de la más alta calidad.

Música

[editar]La psicoacústica incluye temas y estudios que son pertinentes a la Psicología de la música y la musicoterapia. Teóricos como Benjamin Boretz consideran algunos de los resultados de la psicoacústica para ser aplicable sólo en un contexto musical.[10]

Aplicación de la psicoacústica

[editar]

La psicoacústica ha disfrutado de una larga relación con la ciencia computacional, ingeniería computacional, y redes computacionales. Los pioneros en el internet J. C. R. Licklider y Bob Taylor ambos terminaron el trabajo de graduación en psicoacustica BBN Technologies especializado originalmente en la consulta sobre ediciones de la acústica, antes de ella comenzó a construir las primeras redes de ordenadores conmutadas por arranque.

Psicoacústica se aplica dentro de muchos campos de desarrollo de software, en desarrolladores de mapas probados y patrones matemáticos experimentales; en el procesamiento de señal digital, donde muchos códecs de compresión de audio tales como MP3 utilizan un modelo psicoacústico para aumentar las relaciones de compresión; en el diseño de gama alta y sistemas de audio para la reproducción exacta de la música en teatros y casas; así como los sistemas de defensa donde los científicos han experimentado con un éxito limitado en la creación de nuevas armas acústicas, que emiten frecuencias que pueden perjudicar, dañar o matar.[11] También se aplica hoy en día dentro de la música, donde los músicos y artistas siguen creando nuevas experiencias auditivas de enmascaramiento de las frecuencias no deseadas de los instrumentos, haciendo que otras frecuencias sean mejoradas. Otra aplicación es en el diseño de los altavoces de menor calidad o más baja, que pueden usar el fenómeno de la fundamental restante para dar el efecto de las notas graves en las frecuencias más bajas que los altavoces son físicamente capaces de producir.

Véase también

[editar] Portal:Música. Contenido relacionado con Música.

Portal:Música. Contenido relacionado con Música.- Ilusión auditiva

- Sonoridad

- Procesamiento de lenguaje

- Efectos del ruido en la salud

- Tono

- Psicolinguística

- Timbre

Referencias

[editar]Notas

- ↑ Christopher J. Plack (2005). The Sense of Hearing. Routledge. ISBN 0-8058-4884-3.

- ↑ Lars Ahlzen, Clarence Song (2003). The Sound Blaster Live! Book. No Starch Press. ISBN 1-886411-73-5.

- ↑ Rudolf F. Graf (1999). Modern dictionary of electronics. Newnes. ISBN 0-7506-9866-7.

- ↑ Jack Katz, Robert F. Burkard, and Larry Medwetsky (2002). Handbook of Clinical Audiology. Lippincott Williams & Wilkins. ISBN 0-683-30765-7.

- ↑ a b Olson, Harry F. (1967). Music, Physics and Engineering. Dover Publications. pp. 248-251. ISBN 0-486-21769-8.

- ↑ Zwicker, Eberhard (2006). Psychoacoustics: Facts and Models. Springer. pp. 21-22. ISBN 978-3-540-23159-2.

- ↑ Thompson, Daniel M. Understanding Audio: Getting the Most out of Your Project or Professional Recording Studio. Boston, MA: Berklee, 2005. Print.

- ↑ Roads, Curtis. The Computer Music Tutorial. Cambridge, MA: MIT, 2007. Print.

- ↑ Lewis, D.P. (2007): Owl ears and hearing. Owl Pages [Online]. Available: http://www.owlpages.com/articles.php?section=Owl+Physiology&title=Hearing [2011, April 5]

- ↑ Sterne, Jonathan (2003). The Audible Past: Cultural Origins of Sound Reproduction. Durham: Duke University Press.

- ↑ «Copia archivada». Archivado desde el original el 19 de julio de 2010. Consultado el 6 de febrero de 2010.

Fuentes

- E. Larsen and R.M. Aarts (2004), Audio Bandwidth extension. Application of Psychoacoustics, Signal Processing and Loudspeaker Design., J. Wiley.

- Larsen E., Aarts R.M. (marzo de 2002). «Reproducing low-pitched signals through small loudspeakers» (PDF). J. Audio Eng. Soc. 50 (3): 147-164. Archivado desde el original el 21 de noviembre de 2008.

- Oohashi T., Kawai N., Nishina E., Honda M., Yagi R., Nakamura S., Morimoto M., Maekawa T., Yonekura Y., Shibasaki H. (febrero de 2006). «The role of biological system other than auditory air-conduction in the emergence of the hypersonic effect». Brain Research 1073: 339-347. PMID 16458271. doi:10.1016/j.brainres.2005.12.096.

Enlaces externos

[editar]- The musical ear — Perception of sound Archivado el 25 de diciembre de 2005 en Wayback Machine.

- Müller C, Schnider P, Persterer A, Opitz M, Nefjodova MV, Berger M (1993). «[Applied psychoacoustics in space flight]». Wien Med Wochenschr (en alemán) 143 (23–24): 633-5. PMID 8178525. — Simulation of free field hearing by head phones

- GPSYCHO — an open source psycho-acoustic and noise shaping model for ISO based MP3 encoders.

- Definition of: perceptual audio coding

- Java applet demonstrating masking

- HyperPhysics Concepts – sound and hearing

- - The MP3 as Standard Object

- Psicoacústica musical