Perceptron multicouche

| Type | |

|---|---|

| Inventeur |

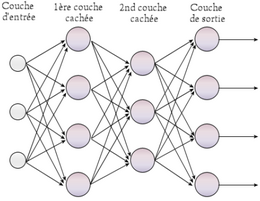

En intelligence artificielle, plus précisément en apprentissage automatique, le perceptron multicouche (multilayer perceptron MLP en anglais) est un type de réseau neuronal artificiel organisé en plusieurs couches. Un perceptron multicouche possède au moins trois couches : une couche d'entrée, au moins une couche cachée, et une couche de sortie. Chaque couche est constituée d'un nombre (potentiellement différent) de neurones. L'information circule de la couche d'entrée vers la couche de sortie uniquement : il s'agit donc d'un réseau à propagation directe (feedforward). Les neurones de la dernière couche sont les sorties du système global.

Le perceptron a été inventé en 1957 par Frank Rosenblatt au Cornell Aeronautical Laboratory[1],[2]. Dans cette première version le perceptron était alors mono-couche et n'avait qu'une seule sortie à laquelle toutes les entrées étaient connectées.

Applications

[modifier | modifier le code]Structure

[modifier | modifier le code]

Les premiers perceptrons étaient constitués d'une unique couche. On pouvait calculer le OU logique avec un perceptron. Par contre, les premiers perceptrons n'étaient pas capables de résoudre des problèmes non linéaires comme le OU exclusif (XOR). Cette limitation fut supprimée au travers de la rétropropagation[3] du gradient de l'erreur dans les systèmes multicouches, proposé par Paul Werbos (en) en 1974 et mis au point douze années plus tard, en 1986 par David Rumelhart (en).

Dans le perceptron multicouche à rétropropagation, les neurones d'une couche sont reliés à la totalité des neurones des couches adjacentes. Ces liaisons sont soumises à un coefficient altérant l'effet de l'information sur le neurone de destination. Ainsi, le poids de chacune de ces liaisons est l'élément clef du fonctionnement du réseau : la mise en place d'un perceptron multicouche pour résoudre un problème passe donc par la détermination des meilleurs poids applicables à chacune des connexions inter-neuronales. Ici, cette détermination s'effectue au travers d'un algorithme de rétropropagation.

Les sorties de chaque neurone de cette couche sont envoyées à la couche suivante, appelée couche cachée, où elles sont combinées et transformées par des fonctions d'activation non linéaires. Cette couche cachée peut avoir un nombre quelconque de neurones, et peut être composée de plusieurs sous-couches si nécessaire.

Exemple : MLP qui calcule le OU exclusif

[modifier | modifier le code]

La figure à droite montre un perceptron multi-couche qui calcule le OU exclusif (XOR). C'est un réseau à trois couches. La couche d'entrée possède deux neurones : et . La couche cachée possède 3 neurones. La dernière couche est la couche de sortie et possède un neurone de sortie.

Algorithme de propagation

[modifier | modifier le code]Expliquons le passage des valeurs d'une couche avec valeurs à la couche suivante avec valeurs[4]. On note l'entrée, c'est-à-dire le vecteur de taille des valeurs prises à une certaine couche. On note le vecteur de taille des valeurs prises à la couche suivante.

On note la matrice des poids des connections entre deux couches successives. Cette matrice est de taille , avec lignes et colonnes. A à la ligne , colonne , on trouve le poids entre l'entrée et la sortie . On note le vecteur des biais ajoutés aux moyennes pondérés des entrées de chaque couches :

L'entrée est propagé à la couche suivante en faisant la moyenne pondéré par les poids de à laquelle on ajoute les biais . Autrement la sortie est donnée par la formule :où est une fonction d'activation, comme par exemple la fonction sigmoïde, ou la fonction ReLU. Autrement dit, la valeur dans le -ème neurone de la couche suivante vaut :

Apprentissage

[modifier | modifier le code]Calcul de l'erreur

[modifier | modifier le code]En connaissant la valeur attendue à la sortie d'un perceptron pour des entrées données, on peut calculer l'écart avec la prédiction grâce à une fonction objectif [5], le plus souvent l'erreur quadratique moyenne (abrégée )[6], telle que :

- ;

Cette fonction n'est pas linéaire, et sa dérivée est plus grande si la prédiction est éloignée de la valeur attendue, permettant ainsi un apprentissage plus rapide[7]. Au contraire, l'erreur moyenne absolue () a une dérivée constante, et donc un taux d'apprentissage qui ne varie pas[8] :

- ;

En minimisant ces fonctions objectif, les prédictions gagnent en précision[9].

Calcul du gradient

[modifier | modifier le code]Durant la phase d'apprentissage, après avoir calculé les erreurs du réseau de neurones, il est nécessaire de les corriger afin d'améliorer ses performances. Pour minimiser ces erreurs – et donc la fonction objectif –, l'algorithme du gradient est le plus souvent utilisé[10]. Le gradient est calculé afin de connaître la variation de la fonction objectif par rapport aux paramètres [11]. Il permet ensuite de modifier ces paramètres proportionnellement à leur impact sur la précision de la prédiction, dans le but d'atteindre après plusieurs itérations le minimum global de la fonction objectif.

La modification des paramètres à un instant se fait tel que :

avec un scalaire, le taux d'apprentissage, et le gradient de la fonction objectif[12]. L'algorithme du gradient permet donc de trouver les paramètres du réseau tel que la somme des erreurs faites par les prédictions sur des données d'entrainement soit la plus faible possible, c'est-à-dire que :

Le gradient se calcule avec la dérivée partielle de la fonction objectif par rapport à chacun des paramètres[13]. Lorsqu'il y a plusieurs paramètres à optimiser, il est exprimé comme un vecteur, parfois noté , puis ajouté au vecteur des paramètres, après avoir été multiplié par le taux d'apprentissage. Le gradient indique la direction vers le maximum de la fonction objectif, et son opposé mène donc vers le minimum[14],[15]. Son expression est donc :

Soit le gradient sur un perceptron de la couche , alors l'ensemble des gradients de cette couche peuvent être stockés et manipulés dans une matrice jacobienne [16], c'est-à-dire une matrice contenant les dérivées partielles de la fonction objectif vectorielle sur toute la couche [17], avec :

- ;

En utilisant le théorème de dérivation des fonctions composées, la variation de la fonction objectif par rapport à l'un des poids est[18] :

- ;

Avec la dérivée partielle de la fonction d'activation, et la dérivée partielle de la fonction objectif par rapport à la prédiction finale . En développant et en utilisant la règle de dérivation des sommes :

- ;

- , si la fonction sigmoïde sert d'activation, ou pour la tangente hyperbolique ;

- ;

L'apprentissage s'arrête lorsque les paramètres convergent vers des valeurs, et que la dérivée de la fonction objectif vaut 0.

Algorithme de rétropropagation

[modifier | modifier le code]- Présentation d'un motif d'entraînement au réseau.

- Comparaison de la sortie du réseau avec la sortie ciblée.

- Calcul de l'erreur en sortie de chacun des neurones du réseau.

- Calcul, pour chacun des neurones, de la valeur de sortie qui aurait été correcte.

- Définition de l'augmentation ou de la diminution nécessaire pour obtenir cette valeur (erreur locale).

- Ajustement du poids de chaque connexion vers l'erreur locale la plus faible.

- Attribution d'un blâme à tous les neurones précédents.

- Recommencer à partir de l'étape 4, sur les neurones précédents en utilisant le blâme comme erreur.

Voir aussi

[modifier | modifier le code]- Connexionnisme

- Neurone formel

- Perceptron

- Réseau de neurones artificiels

- Théorème d'approximation universelle

Notes et références

[modifier | modifier le code]- ↑ (en) Frank Rosenblatt, « The Perceptron, A perceiving and recognizing automaton », Cornell Aeronautical Laboratory, (lire en ligne

[PDF]).

[PDF]).

- ↑ Frank Rosenblatt, « The Perceptron: A Probabilistic Model For Information Storage And Organization in the Brain », Psychological Review, vol. 65, no 6, , p. 386–408 (PMID 13602029, DOI 10.1037/h0042519, S2CID 12781225, CiteSeerx 10.1.1.588.3775)

- ↑ Rumelhart, D. E., Hinton, McClelland, and Williams, R. J. (1986), ―Learning Internal Representations by Error Propagation‖ Parallel Distributed Processing: Explorations in the Microstructure of Cognition

- ↑ Introduction au Machine Learning, (lire en ligne)

- ↑ (en) Shiva Verma, « Understanding different Loss Functions for Neural Networks. », sur Medium, (consulté le )

- ↑ (en) Mohammed Zeeshan Mulla, « Cost, Activation, Loss Function|| Neural Network|| Deep Learning. What are these? », sur Medium, (consulté le )

- ↑ (en-US) « Mean Squared Error: Definition and Example », sur Statistics How To (consulté le )

- ↑ (en) Prince Grover, « 5 Regression Loss Functions All Machine Learners Should Know », sur Medium, (consulté le )

- ↑ (en) Shuyu Luo, « Optimization: Loss Function Under the Hood (Part I) », sur Medium, (consulté le )

- ↑ (en) Niklas Donges, « Gradient Descent: An Introduction to 1 of Machine Learning’s Most Popular Algorithms », sur Built In, (consulté le )

- ↑ (en) Nikil Reddy, « How Does the Gradient Descent Algorithm Work in Machine Learning? », sur Analytics Vidhya, (consulté le )

- ↑ (en-US) Imad Dabbura, « Gradient Descent Algorithm and Its Variants », sur Imad Dabbura, (consulté le )

- ↑ (en) Towards AI Team, « Gradient Descent for Machine Learning (ML) 101 with Python Tutorial », sur Medium, (consulté le )

- ↑ (en) Anjana Yadav, « Why we move opposite to gradients in Gradient Descent?? », sur Medium, (consulté le )

- ↑ (en) Shikhar Goswami, « Why direction of steepest descent is always opposite to the gradient of loss function? », sur Medium, (consulté le )

- ↑ (en) Matthew Barnett, « A Primer on Matrix Calculus, Part 2: Jacobians and other fun - LessWrong », sur Less Wrong, (consulté le )

- ↑ (en) Julien Herzen, « Computing the Jacobian matrix of a neural network in Python », sur Medium, (consulté le )

- ↑ (en) Chi-Feng Wang, « Calculating Gradient Descent Manually », sur Medium, (consulté le )

Bibliographie

[modifier | modifier le code]- Marc Parizeau, Réseaux de Neurones (Le perceptron multicouche et son algorithme de retropropagation des erreurs), Université Laval, Laval, 2004, 272 p.

- Fabien Tschirhart (dir. Alain Lioret), Réseaux de neurones formels appliqués à l'Intelligence Artificielle et au jeu, ESGI (mémoire de master de recherche en multimédia et animation numérique), Paris, 2009, 121 p. [mémoire en ligne (page consultée le 8 novembre 2010)]